Multi-Task Learning với R-CNN-based Models

Nội dung

1. Giới thiệu

Multi-Task Learning (MTL) là kỹ thuật học máy giúp mô hình cùng lúc học nhiều nhiệm vụ khác nhau, tận dụng được thông tin chung giữa các nhiệm vụ để cải thiện hiệu suất tổng thể. Trong lĩnh vực phát hiện đối tượng, các mô hình dựa trên R-CNN có thể được mở rộng để đồng thời thực hiện các tác vụ như phân loại, phát hiện, phân đoạn, hoặc ước lượng vị trí.

MTL giúp giảm thiểu overfitting, tăng khả năng tổng quát và tiết kiệm tài nguyên bằng cách chia sẻ đặc trưng giữa các nhiệm vụ. Bài viết này sẽ tập trung vào cách tích hợp MTL vào các mô hình R-CNN để cải thiện hiệu quả trong các ứng dụng thị giác máy tính.

2. Khái niệm Multi-Task Learning

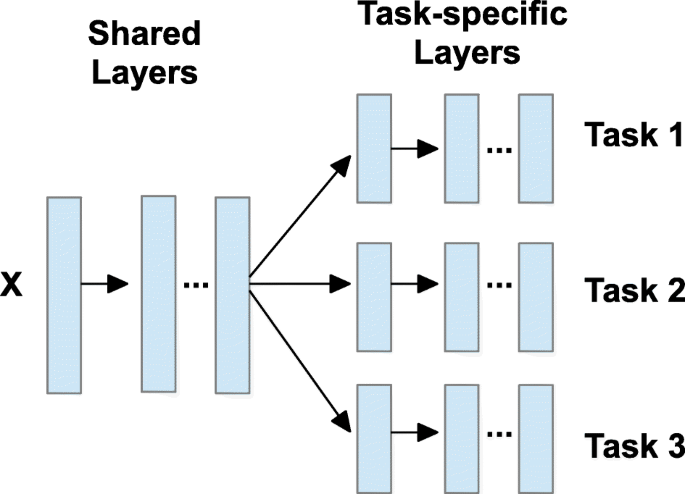

Multi-Task Learning là quá trình huấn luyện một mô hình thực hiện đồng thời nhiều nhiệm vụ khác nhau. Thay vì học từng nhiệm vụ riêng lẻ, MTL khai thác mối liên hệ và đặc trưng chung giữa các nhiệm vụ, giúp mô hình học hiệu quả hơn, giảm overfitting và tăng khả năng tổng quát.

Trong MTL, các nhiệm vụ thường chia sẻ phần lớn kiến trúc mạng (như backbone), nhưng có các nhánh riêng biệt cho từng nhiệm vụ để đảm bảo đầu ra phù hợp.

3. Ứng dụng trong R-CNN

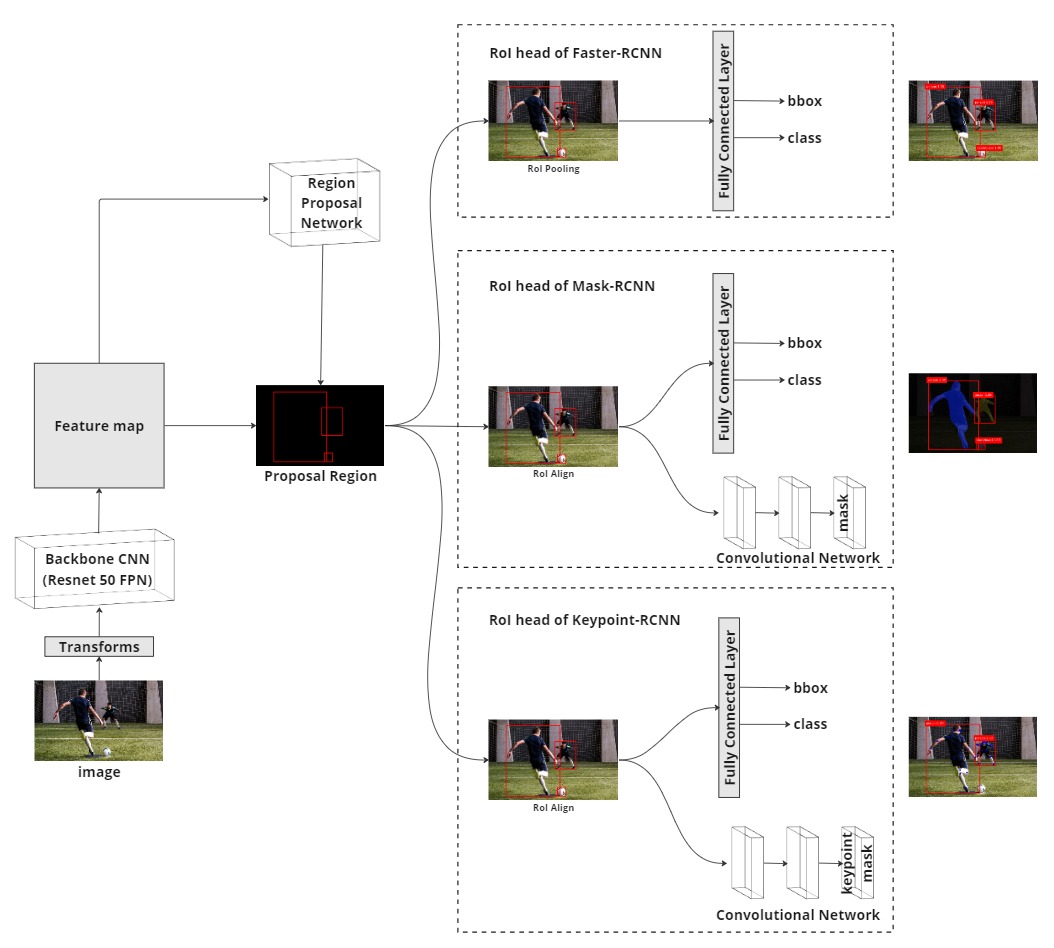

Các mô hình R-CNN được thiết kế theo kiến trúc hai giai đoạn, rất phù hợp để mở rộng cho Multi-Task Learning:

- Faster R-CNN: tập trung vào phát hiện (detection) và phân loại đối tượng.

- Mask R-CNN: thêm nhiệm vụ phân đoạn (segmentation) pixel-wise ngoài phát hiện.

- Keypoint R-CNN: mở rộng thêm nhiệm vụ dự đoán các điểm đặc trưng (keypoints) trên đối tượng.

Cách tiếp cận này tận dụng việc chia sẻ feature backbone và thêm các nhánh đầu ra riêng biệt cho từng nhiệm vụ, giúp mô hình học đồng thời các nhiệm vụ khác nhau trong cùng một framework.